激光雷达如何加速城市 NOA 落地?我们这次展开聊聊

激光雷达如何加速城市 NOA 落地?我们这次展开聊聊

2023 年 11 月 4 号,“激光雷达助力城市 NOA 驶入量产快车道”技术分享会在禾赛麦克斯韦智造中心举办。禾赛战略负责人施叶舟、轻舟智航产品负责人许诺,与行业媒体专家、先锋用户等,一起就激光雷达如何加速赋能城市 NOA 功能落地进行了深入交流。

激光雷达:

车企竞逐城市 NOA 的

“秘密武器”

——by 禾赛战略负责人施叶舟

激光雷达成为车企落地高阶智驾功能的必选项

据近期媒体报道,热门车型的高阶智驾版选装率已经突破了 60% 的占比,消费者对智能驾驶功能的认可和热情持续高涨。主机厂方面,国内率先落地城市 NOA 的智能车型均搭载了激光雷达;海外布局 L3 智驾功能的头部车企也都配备了激光雷达。

率先在美国获得 L3 级智能驾驶运营许可的梅赛德斯-奔驰官方表示:奔驰的 DRIVE PILOT 搭载包含激光雷达在内的多个传感器,足够的安全冗余对实现安全可靠的 L3 级别智能驾驶是必不可少的。其 2024 年款 S 级和 EQS 轿车车型将会搭载此智驾系统。1

本质上,是激光雷达具有「抗干扰」「真三维」「高置信度」的优势,能为算法预测和规控提供高质量的感知输入。

激光雷达既是智能汽车的「隐形安全气囊」,更是加速算法开发落地的「秘密武器」。

MIT:激光雷达夜间融合感知精度是摄像头的 3 倍

工作原理上,激光雷达能主动发射人眼安全的不可见光,可以“自己照亮道路”,不依赖外界环境光,在视线较差的夜晚,也能清晰地还原行车环境,稳定地为算法提供感知数据。

在一项 MIT 的研究论文中,作者对比基于摄像头数据的算法和融合了激光雷达数据的算法结果发现:摄像头算法到了夜晚感知精度有明显的下降,而通过融合激光雷达,可以将夜晚环境的感知精度提升至 3 倍。这项研究结果非常直接地展现了激光雷达对夜晚感知的重要性,能进一步提升夜晚行车的安全。2

同样,在「大光比」「对向强光」等其他摄像头感知相对较差的场景下,激光雷达仍然能凭借接收自身发出的红外光,进行稳定的感知输出。

感知更精准,直击 AEB 误触发行业痛点

AEB 功能的推出,是为了帮助车辆减少碰撞,让行车更加安全。但实际使用过程中,受限于感知精准度,会出现 AEB 误触发事件,即在不该刹车的时候刹车,轻的会使得乘坐体验下降,严重的甚至会导致后车追尾、车内人员受伤。

出现误触发的主要原因是车辆感知精度不足,导致决策失误,比如在遇到减速带、车库转弯、隔离带、路边桩桶,如果对距离、尺寸的感知精度不高,会误以为这些物体阻碍了车辆行驶,威胁到行驶安全,从而触发 AEB。但通过激光雷达的厘米级精度,车辆能做出更加准确的判断,诸如:减速带非常低矮可以通过,隔离带不在行车路径上……

从实际效果看,融合了激光雷达的理想 L9 AEB 误触发率已经低至 0.31 次/10 万公里,远低于行业水平 1 次/10 万公里,把误触发率降低了 70%。3

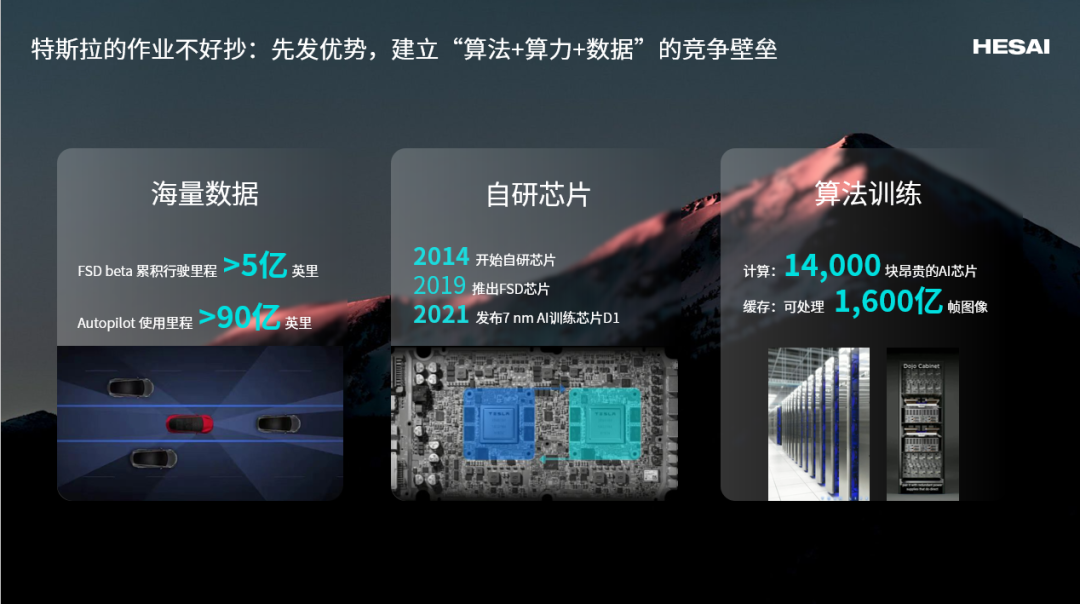

极大降低“算法+算力+数据”等隐性成本

施叶舟指出,特斯拉坚持视觉算法路线,背后隐含的是数据驱动的逻辑。与这套方案相匹配的是特斯拉通过数百万辆车源源不断采集的数据,官方统计,截止 2023 年 10 月,Autopilot 累计行驶里程超 90 亿英里,FSD beta 累计行驶里程超 5 亿英里。4

而为了处理这些海量数据,特斯拉储备了 14000 块总价值数十亿的 AI 芯片,可同时处理 1600 亿帧图像。与此同时,特斯拉从 2014 年开始自研芯片,21 年发布了 7 nm AI 训练芯片以更好地适配算法模型。

“算法+算力+数据”,构成了后来者难以追赶的竞争壁垒。

从全局看,不光要关注看得见的显性成本,更要关注看不见的隐性成本。拿掉激光雷达看似节省了一些硬件成本,但车端感知能力的下降,需要在云端投入更多的资源进行开发,极大抬高了隐性成本,在车辆销量没有非常高的情况下,这些隐性成本均摊下来实际上远高于硬件成本。

激光雷达的加入,

让感知精度领先视觉算法 3 年以上

Nuscenes 是全世界影响力最大的开源数据集之一,各大顶尖算法在该数据集上进行测试打分。统计发现,视觉算法 2023 年所达到的平均感知精度仍然不及融合激光雷达算法在 3 年前的水平。5

与此同时,激光雷达融合算法也在快速迭代升级,多传感器数据的融合方法从基于目标识别结果的「后融合」,到特征级的「中融合」,再向着更加底层的「前融合」发展,平均感知精度在近两年呈现出了加速提升的趋势。

无论是语义识别还是占用网络,

有限的数据训练不能覆盖所有通用障碍物

首先传统的基于“语义识别”的视觉算法,由于需要预先设定物体种类“白名单”,这样的白名单往往只能涵盖高频出现的道路元素和障碍物,例如:机动车、自行车、行人、小孩、水马、红绿灯等,最多几十种类型。按照语义识别的规则,只有白名单以内的物体,才会被准确地标上“标签”,其余不认识的物体都不能被“框住”,也就是会被算法「漏识别」。

例如 2021 年 FSD 推出之后,2022 年 11 月公开测试 6 中,特斯拉面对摆在路上的“黑色小狗”模型,仍然径直开过去,没有刹车。原因在于,视觉算法模型对于道路出现黑色小狗这样的场景训练还不足够,而类似这样的场景难以通过数据训练全部覆盖,总会有没见过的“例外”。

视觉占用网络的推出仍然不能完全解决以上难题。在一项研究占用网络的论文 7 中,算法在对道路进行网格处理时,不常见的“黑色消防栓”就没有被检测为障碍物。究其原因是因为占用网络同样依赖数据训练。为了覆盖更多障碍物的识别,必然伴随着数据采集标注量的增大,对于算法的训练成本投入会持续增加,但是带来的边际效应会越来越小。

相比之下,激光雷达则直接得多,不用训练,有无障碍物可以直接基于空间点云的有无进行判断。

厘米级感知低矮物体,高效追踪近距离物体

低矮物体的准确判断也是视觉算法的难点,考虑到低矮物体往往只有十几厘米或更矮,视觉算法的精度不足以准确测量,因此在没有明显的语义特征时,低矮物体“是否识别到”“有多高”“能不能通过”,成为了影响行车体验乃至安全的不可控因素。

而激光雷达对高度的测量精度稳定在「几厘米」水准 8,即使是低矮物体,也不会出现遗漏。

视觉算法的另一难点是,对于近距离物体的速度监测,需要结合多帧图像以及海量的算法过程,这样的复杂运算大大增加了延时,从而降低了及时性,因此单纯靠视觉算法,应对「近距离加塞」「拥堵跟车」显得力不从心,更别提各种突然窜出来的电动车了。

相比而言,激光雷达凭借三维位置信息,通过简单高效的几何运算就能获取速度,就显得游刃有余的多。从轻舟智航的实测视频来看,融合激光雷达的感知算法很好地应对了各类近距离极限场景。

最后,施叶舟指出,加速城市 NOA 功能量产意味着建立先发优势,而激光雷达正是加速智驾算法开发的利器。谁能将感知算法做到好用,将城市 NOA 功能尽快量产,谁才能尽早获得消费者的认可,在智驾的“战场”上领先一个身位。

城市 NOA 规模化落地,

迎来“ iPhone 时刻”

——by 轻舟智航产品负责人许诺

轻舟智航多款标杆产品搭载激光雷达

许诺首先分享了轻舟智航在 L4 自动驾驶、L2+ 高阶辅助驾驶量产等多款标杆产品中使用了激光雷达,包括在无人驾驶小巴等“龙舟”系列产品上标配了多个「360° 旋转式图像级激光雷达 Pandar128」,在高阶辅助驾驶解决方案“轻舟”系列 MAX 产品上配置了「超高清远距激光雷达 AT128」。

在谈到激光雷达的作用时,许诺直言,现阶段单纯依靠视觉方案,很难应对中国城市道路中的各类 Corner Case。

“激光雷达,是以投入换时间,加速城市 NOA 落地的捷径。” 许诺这样概括。

具体表现为四点:

擅长处理城市复杂场景

当高阶辅助驾驶在开放多样的城区场景落地过程中,会不断地遇到从未见过的棘手问题,如何灵活地与近距离车辆博弈,如何在夜间摄像头视线不佳时稳定行驶,如何在没有车道线的停车楼穿行。轻舟认为,激光雷达对环境的精准感知,能够帮助车辆更好地应对城市的复杂场景。

许诺还在 Q&A 时提到:

不同的传感器是一定会带来不同的系统差别。举例来看,如果是视觉感知,当遇到眩光或者当有物体遮挡住传感器就会降低感知能力,但增加一颗其他的传感器,比如说激光雷达,就会增加一份安全冗余。

以 AEB 为例,如果车辆配备激光雷达,作为算法公司一定会去使用激光雷达,因为已经有了这样一个很好的硬件配置在里面,如果不用,那相当于浪费了。

稳定识别通用障碍物

轻舟具备行业领先的通用障碍物识别能力,融合了激光雷达数据,算法可以在不检测物体类别的情况下对物体进行检出,保证行车安全。

而如果 OmniNet 感知大模型,将多传感器时序穿插融合,通过在重点区域激光雷达与图像的结合将提升感知精度,采用 120° 激光雷达对前向进行了 3D 感知覆盖,帮助算法解决难处理的低速和静态物体,从而用一颗激光雷达方案实现了非常好的城市 NOA 体验。

采用视觉算法,许诺提到:“即便是随着数据量越来越多,能处理更多的长尾场景,但是要把长尾场景全部处理完,实际上是一个非常困难的一个事情。”

轻舟展现了行业领先的 OmniNet 感知大模型,将多传感器时序穿插融合,通过在重点区域激光雷达与图像的结合将提升感知精度,采用 120° 激光雷达对前向进行了 3D 感知覆盖,帮助算法解决难处理的低速和静态物体,从而用一颗激光雷达方案实现了非常好的城市 NOA 体验。

加速算法迭代,

提供精准真值数据,高效挖掘长尾数据

作为高精度的传感器,激光雷达数据可以在点云大模型的解析下进行自动化标注,为算法提供真值,加速算法进化迭代。

许诺在分享时举了两个例子:一个是在夜晚道路上,视觉算法漏检了一辆隔离带对面的车辆,而通过点云标注正确识别了这辆车;另外一个是视觉算法误检了一辆两轮车为三轮车,而通过点云标注同样纠正了这个问题。

最后,激光雷达对物体的识别不依赖预设的语义信息,举例来说,下图中躺在路边的行人,如果没有激光雷达作为感知补充,可能很难识别到。

因此,利用激光雷达数据可以更好地挖掘长尾场景,高效地实现数据积累,进一步加速算法的进化,更早实现量产落地。

我要收藏

个赞

评论排行