CVPR 2024 | 自动化所新作速览(一)

CVPR 2024 | 自动化所新作速览(一)

导读 | CVPR全称为IEEE国际计算机视觉与模式识别会议,是计算机视觉领域三大顶级会议之一。CVPR 2024将在美国西雅图举办。我们将分两期对自动化所的录用研究成果进行简要介绍(排名不分先后),欢迎大家共同交流讨论。

1. 驶向未来:面向自动驾驶的多视图预测与规划的世界模型

Driving into the Future: Multiview Visual Forecasting and Planning with World Model for Autonomous Driving

论文作者:王宇琪,何嘉伟,范略,李鸿鑫,陈韫韬,张兆翔

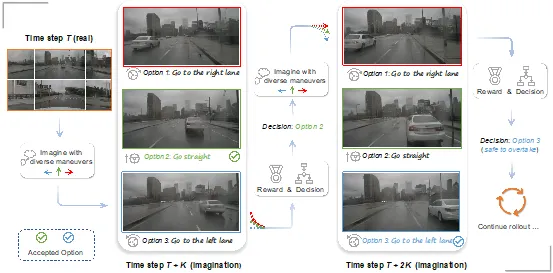

最近,世界模型的概念引发了广泛关注。我们首次提出了一种名为Drive-WM的全新多视图世界模型,旨在增强端到端自动驾驶规划的安全性。Drive-WM模型通过多视图世界模型,能够想象不同规划路线的未来情景,并根据视觉预测获取相应的奖惩反馈,从而优化当前的路线选择,为自动驾驶系统的安全提供了保障。Drive-WM是与现有端到端规划模型兼容的第一个驾驶世界模型。通过视图因子分解促进的联合时空建模,我们的模型在驾驶场景中生成了高保真度的多视角视频。在其强大的生成能力基础上,我们首次展示了将世界模型应用于安全驾驶规划的潜力。对真实世界驾驶数据集的评估验证了我们的方法可以生成高质量、一致性和可控性的多视角视频,为真实世界的模拟和安全规划开辟了新的可能性。

图1. 自动驾驶世界模型

图2. 基于多视图世界模型的预测和规划

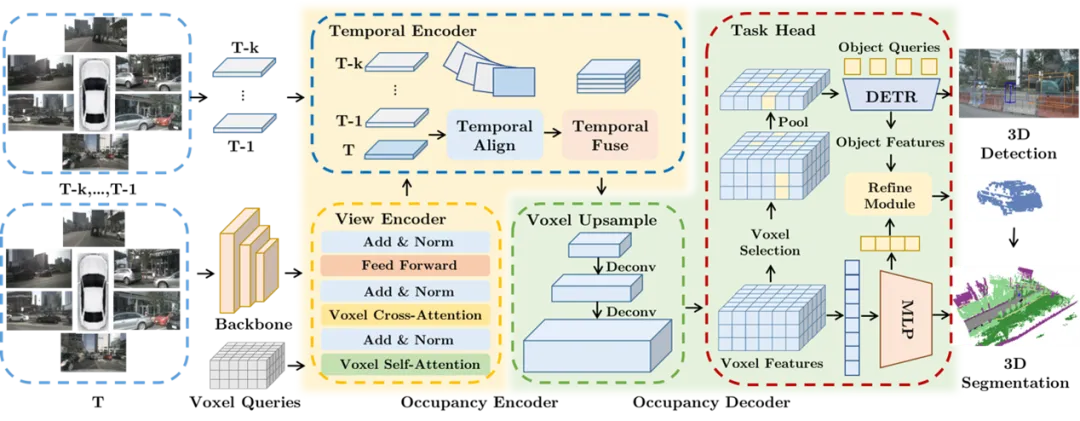

2. PanoOcc:面向视觉三维全景分割任务的统一栅格占用表示

PanoOcc: Unified Occupancy Representation for Camera-based 3D Panoptic Segmentation

作者:王宇琪,陈韫韬,廖星宇,范略,张兆翔

全面的三维场景感知对于自动驾驶和机器人领域至关重要。基于相机的三维感知取得了迅速发展,但过去的任务如三维目标检测、地图语义分割等,各自关注场景表示的某一方面,且表示方式不统一。我们希望能够探索一种统一的场景表示,使其能统一表达这些任务,并将背景和前景物体统一建模。目前基于鸟瞰图特征的方法在三维目标检测上表现出色,但由于缺失了高度和形状信息,直接应用于三维场景感知任务时性能较差。这启示需要探索适合三维场景的特征表示,这也使得三维的栅格占用表示重新受到关注。然而,与二维空间相比,三维空间更加稀疏,直接将二维鸟瞰图特征扩展到三维体素表示将带来巨大的显存和计算开销。本研究提出PanoOcc模型,将检测和分割任务联合学习,统一了检测和分割任务的输出表示。为实现高效的特征学习,我们设计了从粗到细的解码层结构,并探索了稀疏表示的应用。本研究进行了大量消融研究以验证有效性和效率,在基于相机的机的三维语义分割、全景分割和密集占用栅格预测等任务中都取得了最先进性能。

图. PanoOcc的整体模型设计

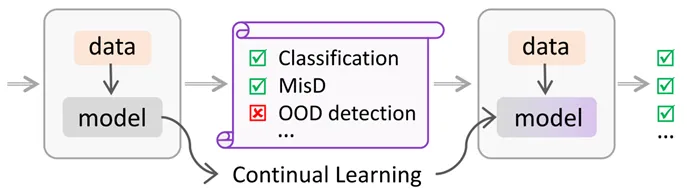

3. 基于可靠持续学习的失败检测

RCL: Reliable Continual Learning for Unified Failure Detection

作者:朱飞,程真,张煦尧,刘成林,张兆翔

深度神经网络往往对未知输入过于自信,给实际应用带来了较大风险。已有研究主要关注检测来自未知类别的分布外样本,而忽略了来自已知类别的错分样本。最近的研究发现,分布外检测方法往往对错分检测有害,表明这两项任务之间似乎存在折中。本文研究了统一失败检测问题,即同时检测错分样本和分布外样本。我们发现对二者的学习目标进行联合训练不足以获得统一检测的能力,而序列学习的模式有较大潜力。受此启发,本文提出了一种可靠的持续学习范式,使模型先具备错分检测的能力,然后在不降低已有可靠性的前提下通过持续学习提升模型的分布外检测能力。实验表明,该方法具有优异的失败检测性能。

可靠持续学习示意图

4. 基于偏振光融合优化的深度测量增强方法

Robust Depth Enhancement via Polarization Prompt Fusion Tuning

作者:池村敬,黄一鸣,菲利克斯·海德,张兆翔,陈启峰,雷晨阳

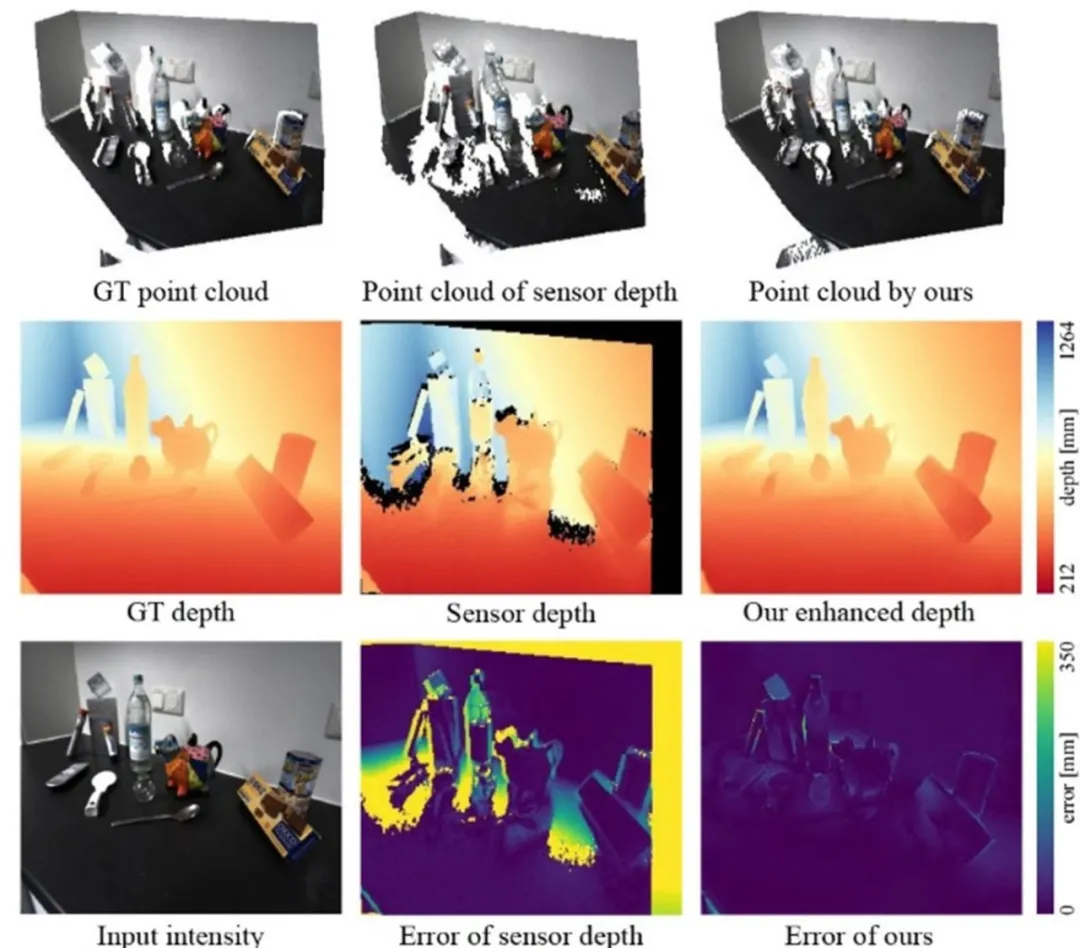

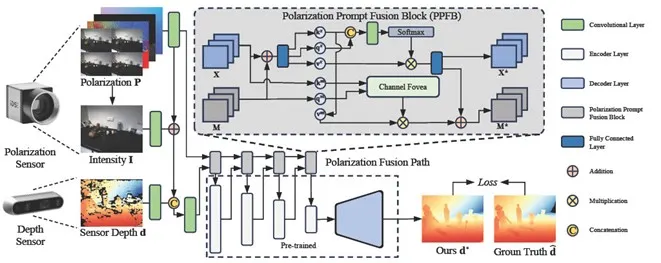

本文提出了一个利用偏振成像改进各种深度传感器不准确深度测量的通用框架。现有的深度传感器在存在透明或反射物体的复杂场景中会提供不准确的深度值,而此前基于偏振的深度增强方法主要利用纯物理公式来处理单一传感器的数据。相比之下,本文所提出的方法采用深度学习,通过训练神经网络从偏振数据和来自不同传感器的传感器深度图来获得更稠密准确的深度图。本文提出了一种称为Polarization Prompt Fusion Tuning (PPFT)的策略,其利用在大规模RGB数据集上预训练的模型,在规模有限的偏振数据集上进行融合增强,从而有效地训练出更强大的深度增强模型。本文在一个公共数据集上进行了大量实验证明,与现有的深度增强基准方法相比,所提出的方法表现最佳。

图1. 图中数据来自偏振相机以及d-ToF深度传感器,本方法在具有挑战性的深度增强问题上产生准确的结果,包括深度补全、透明表面的深度修复、形状校正等。如图所示,透明水瓶处的深度被有效修复 。

图2. 本文所提出的偏振提示融合块(PPFB)将偏振光信息作为额外视觉提示输入,采用递进的方法依次融合到从预训练层提取的特征中。

5. MemoNav: 基于类人工作记忆的视觉导航智能体

MemoNav: Working Memory Model for Visual Navigation

论文作者:李鸿鑫,王泽禹,杨旭,杨雨然,梅树起,张兆翔

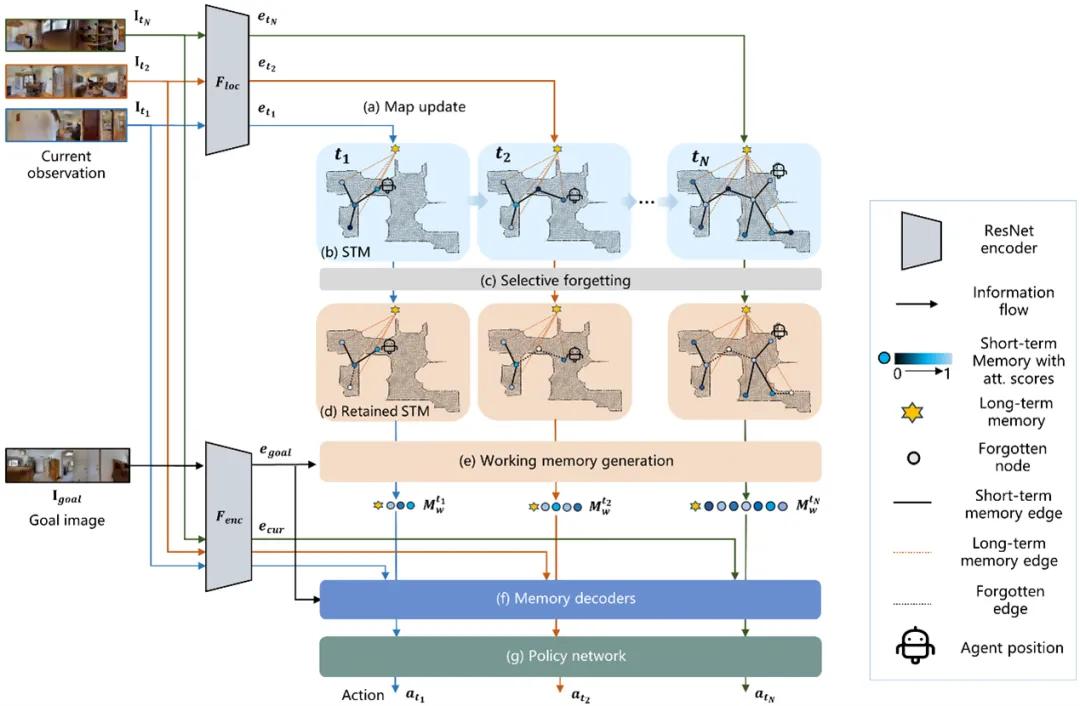

人类导航至多目标时,会回忆起与目标相关的地点特征,忽视其他无关区域的记忆,并利用激活的这部分局部信息来快速规划路线,无需重复探索。MemoNav借鉴人类这种工作记忆机制,结合短期记忆和长期记忆一起提升导航决策性能(图1)。其引入了遗忘机制、长期记忆、和工作记忆三个协同组件:

选择性遗忘机制 由于并非所有地图结点都和导航目标有关,MemoNav提出利用目标注意力机制,计算地图结点和当前目标的注意力分数,然后暂时“遗忘”分数较低即对导航帮助不大的偏远结点,被保留的则用于下游决策。

长期记忆 为了习得场景的全局表征,智能体维护一个和所有短期记忆结点相连的全局结点作为长期记忆,不断地通过图注意力机制聚合短期记忆特征。

工作记忆 利用一个图注意力机制编码保留的短期记忆和长期记忆,得到和当前导航任务最相关的工作记忆,输入给下游策略模块以得到最终导航行为。

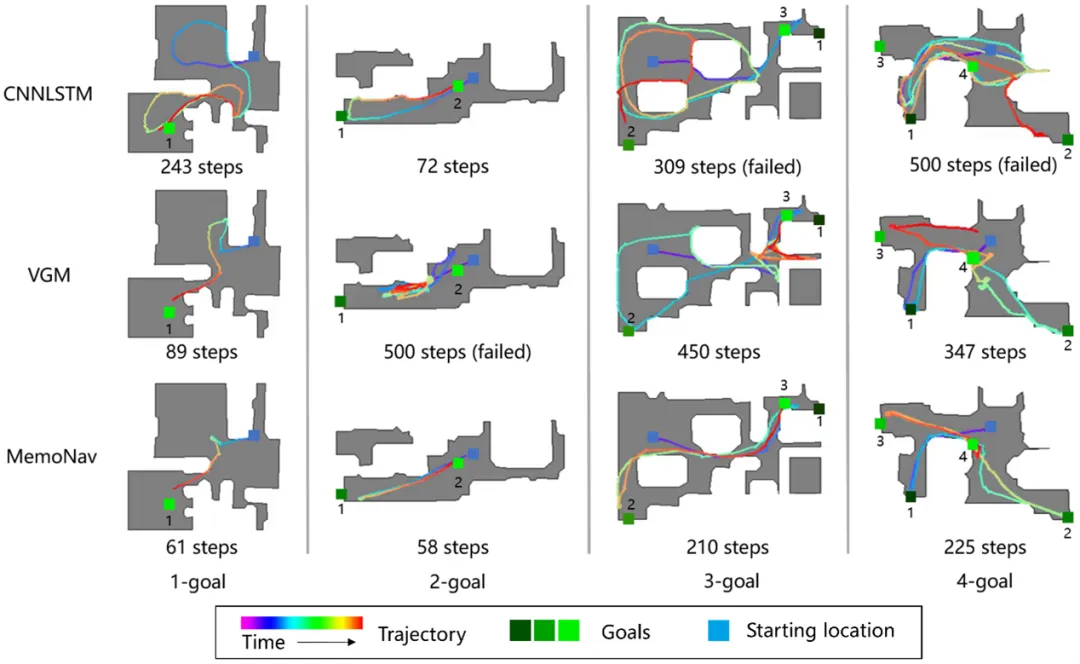

在Gibson和Matterport3D场景中,该方法的多目标导航性能大幅超越SoTA模型。定性实验显示其可以规划更快捷的路径,且死锁概率更小(图2)。

图1. MemoNav借鉴人脑工作记忆的导航模型。MemoNav通过注意力机制选择与当前导航目标相关的短期记忆(即地图结点)和长期记忆(即全局结点)一起生成工作记忆,用于下游决策。

图2. MemoNav和现有其它方法的定性对比。

6. 预训练视觉模型的连续遗忘

Continual Forgetting for Pre-trained Vision Models

论文作者:赵宏博、尼博琳、樊峻菘、王玉玺、陈韫韬、孟高峰、张兆翔

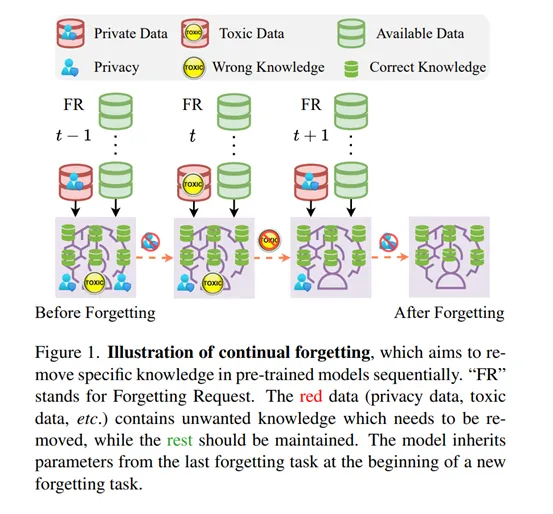

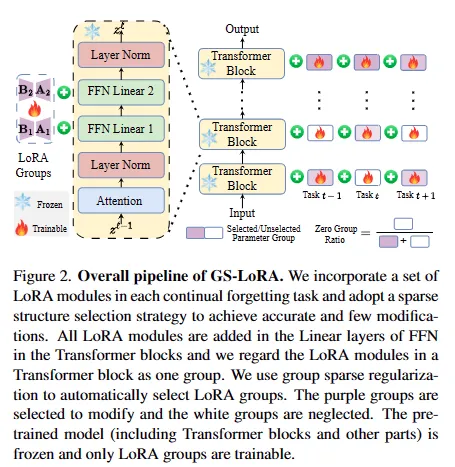

出于隐私和安全考虑,如今变得越来越明显的是,需要从预训练的视觉模型中擦除不需要的信息。在现实世界场景中,用户和模型拥有者可以随时提出擦除请求。这些请求通常形成一个序列。因此,在这样的设置下,期望从预训练模型中连续移除选定信息,同时保留其余信息。我们将这个问题定义为持续遗忘,并确定了两个关键挑战。(i) 对于不需要的知识,有效且高效的删除至关重要。(ii) 对于剩余的知识,遗忘过程带来的影响应尽可能小。为了解决这些问题,我们提出了群稀疏LoRA(GS-LoRA)。具体来说,针对(i),我们使用LoRA模块独立地对Transformer块中的FFN层进行微调,以应对每个遗忘任务,并针对(ii),采用了简单的组稀疏正则化,实现了特定LoRA群组的自动选择并将其他群归零。GS-LoRA有效、参数高效、数据高效且易于实现。我们在人脸识别、目标检测和图像分类上进行了广泛实验,并展示了GS-LoRA能够在对其他类别影响最小的情况下忘记特定类别。

图1. 连续遗忘

图2. GS-LoRA管线示意图

7. 通过语言引导监督加强视觉连续学习

Enhancing Visual Continual Learning with Language-Guided Supervision

论文作者:尼博琳、赵宏博、张承灏、胡珂、孟高峰、张兆翔、向世明

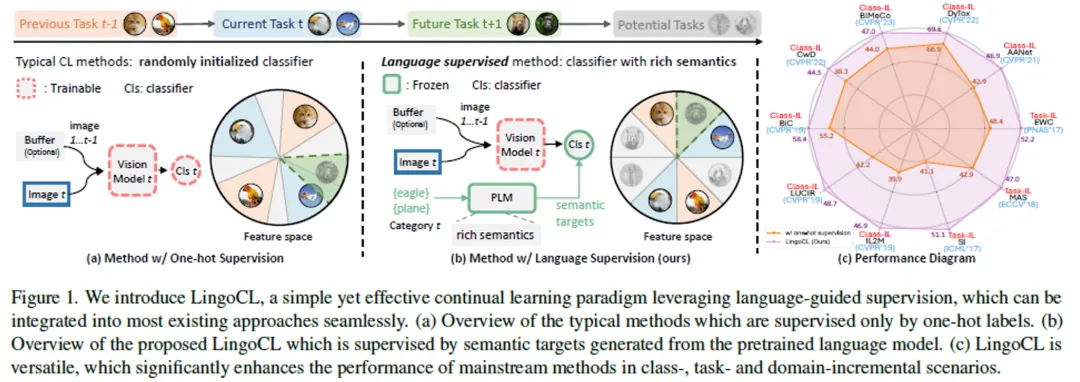

连续学习旨在使模型能够在不忘记先前获得的知识的情况下学习新的任务。当前的工作往往集中在网络结构、回放数据和正则化等技术。然而,数据类别标签中的语义信息在很大程度上被忽略了。当前的方法往往使用独热标签,每个任务独立学习分类头。我们认为,独热标签无法捕捉连续学习场景下不同类别跨任务的语义关系,阻碍了知识在任务间的有效转移。在本工作中,我们重新审视了分类头在连续学习场景中的作用,并用来自预训练语言模型的语义知识取代了随机初始化的分类头。具体来说,我们使用预训练语言模型为每个类别生成语义目标,这些目标在训练期间被冻结作为监督信号。这些目标充分考虑了跨任务的所有类之间的语义相关性。实证研究表明,我们的方法通过减轻表征漂移和促进跨任务的知识转移来减轻遗忘。所提出的方法易于实现,并且可以无缝地插入到现有方法中。

图1. LingoCL示意图及效果

8. HardMo:一个大规模难例动作捕捉数据集

HardMo: A Large-Scale Hardcase Dataset for Motion Capture

论文作者:廖佳琪,罗传琛,杜伊诺,王玉玺,殷绪成,张曼,张兆翔,彭君然

本文介绍了一个大规模的难例动作捕捉数据集——HardMo,旨在弥补现有人体mesh恢复方法(HMR)在处理舞蹈和武术等场景中不常见姿势的不足。由于这些领域的动作具有高速度和高张力特征,而现有数据集大多聚焦于日常动作,缺乏这类复杂动作的样本,导致模型难以有效处理舞蹈和武术场景。为此,我们提出了一套数据收集流程,包括自动爬取、精确标注和难例挖掘,基于此流程快速建立了包含700万张的大型数据集HardMo。这些覆盖了15类舞蹈和14类武术,每张都配有精确的标注。实验发现,舞蹈和武术中的预测失败主要表现在手腕和脚踝的不对齐上。此外针对这两个难点,我们利用提出的自动化流程筛选出相关数据,构建了名为HardMo-Hand和HardMo-Foot的子集。广泛的实验表明,我们的标注流程和数据驱动解决方案的有效性。特别是,经HardMo训练后的HMR方法甚至在我们的基准测试上超过了当前的最先进技术4DHumans。

9. 属性引导的行人检索:跨越行人重识别中的内在属性变化

Attribute-Guided Pedestrian Retrieval: Bridging Person Re-ID with Internal Attribute Variability

论文作者:黄延、张彰、吴强、钟怡、王亮

在智能监控领域中,行人检索(重识别)技术,扮演着至关重要的角色。目前的Re-ID方法常常忽略对行人细微属性变化所导致的外观变化显式建模。针对这一问题,我们的研究提出了视觉属性引导的行人检索(AGPR)任务,旨在通过对特定人体属性查询条件与查询图像的整合来提高行人检索准确性。我们提出的基于ViT属性引导的行人检索(ATPR)框架通过对行人属性组间相关性和属性组内去相关性建立正则化项,有效地融合了全局行人ID识别与局部属性学习。我们基于RAP行人属性数据集构建了新的AGPR任务基准,并进行了广泛实验,结果验证了我们提出的ATPR方法在AGPR任务中的有效性。

10. 调查视觉-语言模型在视觉定位任务上的组合关系挑战

Investigating Compositional Challenges in Vision-Language Models for Visual Grounding

论文作者:曾宇楠,黄岩,张津津,揭泽群,柴振华,王亮

预训练的视觉-语言模型(VLMs)在各种下游任务中取得了高性能,这些模型已被广泛应用于视觉定位任务。然而,尽管大规模的视觉和语言预训练贡献了性能提升,我们发现最先进的VLMs在定位任务的组合推理上存在困难。为了证明这一点,我们提出了属性、关系和主次定位(ARPGrounding)基准测试,以测试VLMs在视觉定位任务中的组合推理能力。ARPGrounding包含11,425个样本,并从三个维度评估VLMs的组合理解能力:1)属性,测试对目标属性的理解;2)关系,测试对目标之间关系的理解;3)主次,反映了与名词相关的词性的意识。使用ARPGrounding基准测试,我们评估了几种主流的VLMs。实验结果表明,这些模型在传统的视觉定位数据集上表现相当好,达到或超过了最先进方法的性能,然而在组合推理上显示出明显的不足。更进一步,我们提出了组合关系感知的微调流程,展示了利用低成本的图像-文本标注来增强VLMs在定位任务中的组合理解能力的潜力。

11. 多模态提示感知器:为多功能图像复原赋能自适应性、泛化性和保真度

Multimodal Prompt Perceiver: Empower Adaptiveness, Generalizability and Fidelity for All-in-One Image Restoration

论文作者:论文作者:艾雨昂,黄怀波,周晓强,王杰翔,赫然

本文介绍了一种名为MPerceiver的多模态提示学习方法,旨在解决多功能图像复原中面临的复杂真实场景退化问题。MPerceiver通过利用Stable Diffusion中的先验知识来增强自适应性、泛化性和保真度。具体来说,本文提出了一个双分支模块提供多模态提示:文本提示用于整体表征,而视觉提示用于多尺度细节表征。这两种提示通过CLIP图像编码器的退化预测动态调整,能够适应各种未知的退化情况。此外,MPerceiver采用了一个插件式细节精炼模块,通过编码器到解码器的信息跳连,改善了图像复原的保真度。MPerceiver在9个图像复原任务中进行了训练,并且在许多任务中甚至超越了最先进的特定任务方法。在多任务预训练之后,MPerceiver学习到了底层视觉的通用表征,展现了强大的Zero-Shot和Few-Shot能力。在16个复原任务上的实验证明了MPerceiver在自适应性、泛化性和保真度方面的优越性。

12. 基于小波增强Transformer和不确定性感知的无源自适应图像超分辨率

Uncertainty-Aware Source-Free Adaptive Image Super-Resolution with Wavelet Augmentation Transformer

论文作者:艾雨昂,周晓强,黄怀波,张磊,赫然

无监督领域适应能够通过同时访问源数据和目标数据,有效地解决真实场景图像超分辨率中的域差异问题。考虑到实际场景中源数据的隐私政策或传输限制,本文提出了一种无源领域自适应框架SODA-SR用于图像超分辨率。SODA-SR利用源训练模型生成精细化的伪标签,用于师生学习。为了更好地利用伪标签,本文提出了一种新颖的基于小波的增强方法,名为小波增强Transformer,它可以灵活地结合现有网络,隐式地产生有用的增强数据。此外,本文提出了一种不确定性感知的自训练机制,以提高伪标签的准确性,不准确的预测将通过不确定性估计得到纠正。实验表明,即使不访问源数据,SODA-SR也在多种设置中超越最先进的UDA方法,并且不受特定网络架构的限制。

RMT: Retentive Networks Meet Vision Transformers

论文作者:樊齐航,黄怀波,陈铭锐,刘红敏,赫然

最近,Retentive Network(RetNet)作为一种有可能取代Transformer的架构出现,引起了自然语言处理社区的广泛关注。作者将RetNet的思想迁移到视觉领域并将RetNet和Transformer结合起来,提出了RMT。受RetNet启发,RMT在视觉Backbone中引入了显式衰减,将与空间距离相关的先验知识引入到视觉模型中。这种与距离相关的空间先验允许显式控制每个Token可以关注的Token范围。此外,为了降低全局建模的计算成本,作者沿图像的两个坐标轴分解了这个建模过程。大量的实验表明,RMT在各种计算机视觉任务如分类、目标检测、实例分割和语义分割等中表现出色。

14. 面向测试过程检测及修复的神经后门防御

Backdoor Defense via Test-Time Detecting and Repairing

论文作者:关霁洋,梁坚,赫然

针对神经后门防御问题,之前的工作主要在模型部署之前使用干净样本来去除模型神经后门,而本文研究了利用部分污染的模型测试数据从模型中去除神经后门,并提出了一种两阶段的神经后门防御方法。在第一阶段,本文提出了一种后门样本检测方法DDP,它从一批混合的部分投毒数据中识别出后门样本,其后,本文使用夏普利值估计定位并去除模型中的神经后门。我们的的方法TTBD在多种网络结构下针对多种不同的神经后门攻击,均取得了良好的神经后门防御效果。

15. MoPE-CLIP:使用模块化剪枝误差度量的高效视觉-语言模型结构化剪枝方法

MoPE-CLIP: Structured Pruning for Efficient Vision-Language Models with Module-wise Pruning Error Metric

论文作者:林浩坤,柏昊立,刘智立,侯璐,孙沐毅,宋林琦,魏颖,孙哲南

本文探索了多种多模态视觉语言预训练模型(如CLIP)的小型化方案,研究发现直接使用较小的预训练模型或应用基于权重大小的剪枝,往往导致灵活性不足和性能不佳。针对上述挑战,我们提出了一种新颖的模块化剪枝误差(MoPE)度量方法,旨在精确评估CLIP模块在跨模态任务中的重要性。利用MoPE度量,我们进一步提出适用于预训练和特定任务微调两个压缩阶段的剪枝框架,同时设计了更高效的知识蒸馏损失函数。在预训练阶段,MoPE-CLIP利用教师模型的知识,显著减少了预训练成本,并保持CLIP模型强大的零样本能力。在微调阶段,通过先宽度剪枝再深度剪枝的方式,我们能够在特定任务上产生性能强大的专用模型。我们通过两个阶段的广泛实验验证了MoPE度量的有效性, MoPE-CLIP超越了之前最先进的多模型模型剪枝方案,与先前采用单一模态剪枝度量或涉及昂贵的可学习掩模搜索过程的方法相比,我们的方法不仅提高了性能,而且提供了一种更灵活、成本效益更高的解决方案。

16. SfmCAD:基于“草图+特征”建模的无监督CAD重建

SfmCAD: Unsupervised CAD Reconstruction by Learning Sketch-based Feature Modeling Operations

论文作者:李朴,郭建伟,李慧斌,Bedrich Benes,严冬明

SfmCAD通过学习现代CAD工作流中基于草图的特征建模操作来重构三维形状。给定一个体素形式表示的三维形状,SfmCAD能够无监督地学习一种草图+路径参数化表示方法,包括形状部件的二维草图及其三维扫掠路径。SfmCAD利用二维草图来表达局部几何细节,并通过三维路径捕捉整体结构,实现了形状细节与结构之间的解耦。这种转化为参数化形式的方法不仅增强了模型的可解释性,还提高了输出结果的可编辑性,使用户能够方便地编辑形状的几何和结构特征。我们通过将SfmCAD应用于各种不同类型的对象,如CAD部件、ShapeNet形状和树干结构,展示了我们方法的有效性。

17. SVDTree:基于语义体素扩散模型的单张图像树木三维重建

SVDTree: Semantic Voxel Diffusion for Single Image Tree Reconstruction

论文作者:李源、刘志浩、Bedrich Benes、张晓鹏、郭建伟

高效地表示和重建树木的三维几何仍然是计算机视觉和图形领域中的一个极具挑战性的问题。本研究提出了一种新颖的方法,用于从单个视角的照片生成逼真的树木三维模型。本研究将三维信息推理问题转化为语义体素扩散过程,该过程将树木的输入图像转换为三维空间中的新颖语义体素结构(SVS)。SVS编码了几何外观和语义结构信息(例如树干、树枝和树叶),从而保留了复杂的树木内部特征。针对SVS,本研究提出了一种新的混合树木建模方法,SVDTree,包括面向结构的树干重建和基于自组织的树冠重建两部分。本研究使用合成和真实树木的图像对SVDTree进行了算法验证和对比,结果表明,本研究方法能够更好地保留树木细节,并实现了更为逼真和准确的重建结果。

18. UnionFormer: 用于图像篡改检测和定位的多视角表征联合学习Transformer模型

UnionFormer: Unified-Learning Transformer with Multi-View Representation for Image Manipulation Detection and Localization

论文作者:李帅伯、马伟、郭建伟、徐世彪、李本冲、张晓鹏

本研究提出了UnionFormer,一种针对图像篡改检测与定位的新颖Transformer框架,它采用联合学习机制,整合了三个不同视角的篡改信息,以准确判别真伪图像。在该研究中,我们设计了能够从RGB视角和噪声视角交互提取篡改表征的BSFI-Net,其不仅对边界处的异常痕迹有着敏感的响应,而且能够建模多尺度的空间连续性。此外,本研究引入图像内不同目标间的不一致性作为全新的判别视角,并将其构建过程与检测、定位任务融合于一个统一的三任务联合学习架构中,从而实现不同任务间的相互促进。由此,本研究提出的模型在多重监督下,成功学习并整合三个视角的篡改判别特征,实现了高性能的同步检测与定位。实验结果表明,与先前的方法相比,本研究方法对多种类型的图像篡改具有更高的检测与定位准确率。

我要收藏

个赞

评论排行