AI 开发不必"因噎废食",但必须以伦理为先

|

【ZiDongHua 之 人文化天下:IBM 、生成式AI 、ChatGPT 、AI伦理 】

AI 开发不必"因噎废食",但必须以伦理为先

本文作者:Christina Montgomery,IBM首席隐私诚信官;Francesca Rossi,IBM研究院AI伦理全球负责人

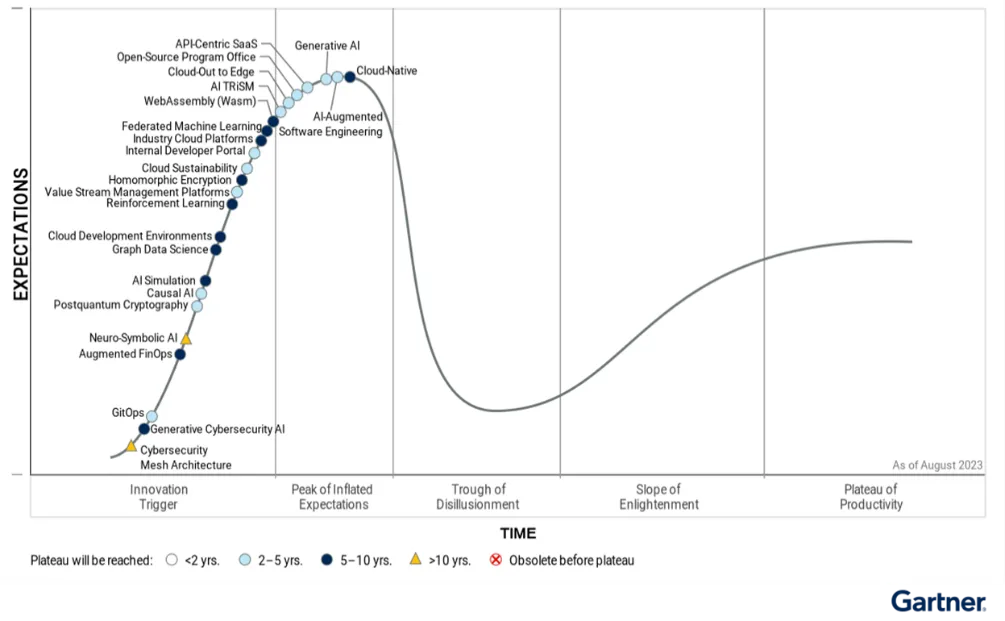

随着生成式 AI 系统进入公共领域,让世界各地的人们接触到新的技术可能性、影响,甚至是此前尚未考虑的后果。得益于 ChatGPT和其他类似的系统,现在几乎任何人都可以使用高级 AI 模型,这些模型不仅能够具有早期版本的检测模式、挖掘数据和提出建议等能力,还能创造新内容、在对话中生成原创的回复等。

AI 开发不必“因噎废食”,但必须以伦理为先

AI 发展的转折点

当生成式 AI 功能的设计合乎伦理、并以负责任的方式推向市场时,它将为企业和社会带来前所未有的机遇,包括:提供更好的客户服务,改善医疗系统和法律服务;以及支持和增强人类的创造力,加快科学研发,并调动更有效的方法来应对气候挑战。

关于AI 的开发、部署和使用及其加速人类进步的潜力,我们正处于一个关键节点。然而,这种巨大的潜力也伴随着风险,例如产生虚假内容和有害文本、泄露隐私,偏见被放大,同时,这些系统的运行也缺乏透明度。因此,合理质疑 AI 对于劳动力、创造力以及人类整体福祉意味着什么,这至关重要。

行业需要新的 AI 伦理标准

最近,一些科技行业的意见领袖联名呼吁,将大型AI 模式的训练暂停 6 个月,以留出时间制定新的AI伦理标准。其意图和动机无疑是好的,但它忽略了一个基本事实:这些系统目前仍在我们的控制范围内,基于它们构建的解决方案也是如此。

负责任的训练,以及基于多方合作、将AI伦理贯穿始终的开发路径,可以使这些系统变得更好而不是更糟。AI技术无时不刻都在演进和迭代。因此,不论是正在使用或是等待上线的AI系统,其训练必须与构建负责任的AI这一目标保持一致。以负责任的AI为先不意味着要暂停AI开发。

持续采用和完善AI 伦理标准和规范,这项工作事关人人。IBM 在多年前就建立了行业最早的 AI 伦理委员会之一,以及全公司范围内的 AI 伦理框架。通过评估当前和未来的技术格局,包括我们的行业定位以及与利益相关方的协作,我们不断加强和完善这一框架。

IBM的AI伦理委员会打造了一个负责任的集中式治理结构,它覆盖AI的全生命周期,在制定明确政策、推动问责制的同时,也能灵活且敏捷地支持IBM的业务需求。在传统的和更先进的 AI 系统开发中,IBM一直践行着这一重要治理结构。我们不能只关注未来的风险,而忽视眼前的治理需要,比如价值对齐(value alignment,即AI在执行任务中实现的价值和用户所希望的价值是一致的)和 AI 伦理;后者也会随着 AI 的发展而不断演进。

除了协作和监督,打造这些AI系统的技术路径应该从一开始就考虑伦理因素。例如,我们对 AI 的担忧往往源于对"黑匣子"内部发生的情况缺乏了解。因此,IBM 开发了一个监管平台,用于监控模型的公平性和偏见与否,获取数据来源,最终形成更透明、可解释且可靠的 AI 管理流程。此外,IBM的企业级AI战略将信任嵌入整个AI生命周期中,从创建模型、训练系统所使用的数据,到这些模型在特定业务领域的应用。

接下来需要做什么?

首先,我们倡导企业将伦理和责任置于其 AI 议程的首位。全面暂停 AI 训练或是降低AI 伦理的行业优先级,最终将事与愿违。

其次,政府应避免在技术层面对 AI 进行过度监管。否则,这将成为一场"打地鼠"游戏,阻碍真正有益的、面向未来的创新。我们呼吁世界各地的立法者采取更加高效且精准的监管模式,对高风险的 AI 用例实施严格监管。

最后,在企业如何保护与 AI 系统交互的数据隐私方面,仍然缺乏足够的透明度。 我们需要为用户提供一致的、可落地的个人隐私保护。

最近社会对 AI 的广泛关注,正应了这句话:权力越大,责任越大。与其全面暂停 AI 系统的开发,不如打破协作壁垒,共同打造负责任的AI。

【关于IBM】

IBM 是全球领先的混合云、人工智能及企业服务提供商,帮助超过 175 个国家和地区的客户,从其拥有的数据中获取商业洞察,简化业务流程,降低成本,并获得行业竞争优势。金融服务、电信和医疗健康等关键基础设施领域的超过 4000家政府和企业实体依靠 IBM 混合云平台和 Red Hat OpenShift 快速、高效、安全地实现数字化转型。IBM 在人工智能、量子计算、行业云解决方案和企业服务方面的突破性创新为我们的客户提供了开放和灵活的选择。对企业诚信、透明治理、社会责任、包容文化和服务精神的长期承诺是 IBM 业务发展的基石。

评论排行